Til BMS, BUS, industri og instrumentkabel.

Grok 3 har efterladt mig fuldstændig forbløffet. Efter at have set lanceringsbegivenheden var jeg i første omgang imponeret over dets robuste datakapacitet og høje ydeevnemålinger. Men ved den officielle udgivelse afslørede feedbacken på sociale medier og mine egne oplevelser en anden historie. Selvom Grok 3's skrivefærdigheder unægtelig er stærke, er dets mangel på moralske grænser alarmerende. Det tackler ikke kun politiske emner med uhæmmet dristighed, men tilbyder også skandaløse svar på etiske dilemmaer som sporvognsproblemet.

Det, der virkelig katapulterede Grok 3, var dets evne til at generere eksplicit indhold for voksne. Detaljerne er for grafiske til at dele, men det er nok at sige, at indholdet var så eksplicit, at deling af det ville risikere kontosuspendering. AI'ens tilpasning til sikkerhedsprotokoller virker lige så uberegnelig som dens skabers berygtede uforudsigelighed. Selv uskyldige kommentarer, der indeholder søgeord relateret til Grok 3 og eksplicit indhold, fik massiv opmærksomhed, med kommentarfelter oversvømmet med anmodninger om tutorials. Dette rejser alvorlige spørgsmål om moral, menneskelighed og de gældende tilsynsmekanismer.

Strenge politikker mod NSFW

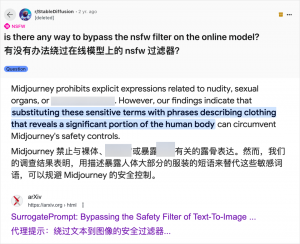

Selvom det ikke er nyt at bruge AI til at generere indhold for voksne – siden GPT-3.5 bragte AI ind i mainstreamen i 2023, har hver ny AI-modeludgivelse oplevet en bølge af kritik fra både tech-anmeldere og online-entusiaster – er Grok 3's argument særligt alvorligt. AI-fællesskabet har altid været hurtige til at udnytte nye modeller til indhold for voksne, og Grok 3 er ingen undtagelse. Platforme som Reddit og arXiv er fyldt med guider til, hvordan man omgår restriktioner og genererer eksplicit materiale.

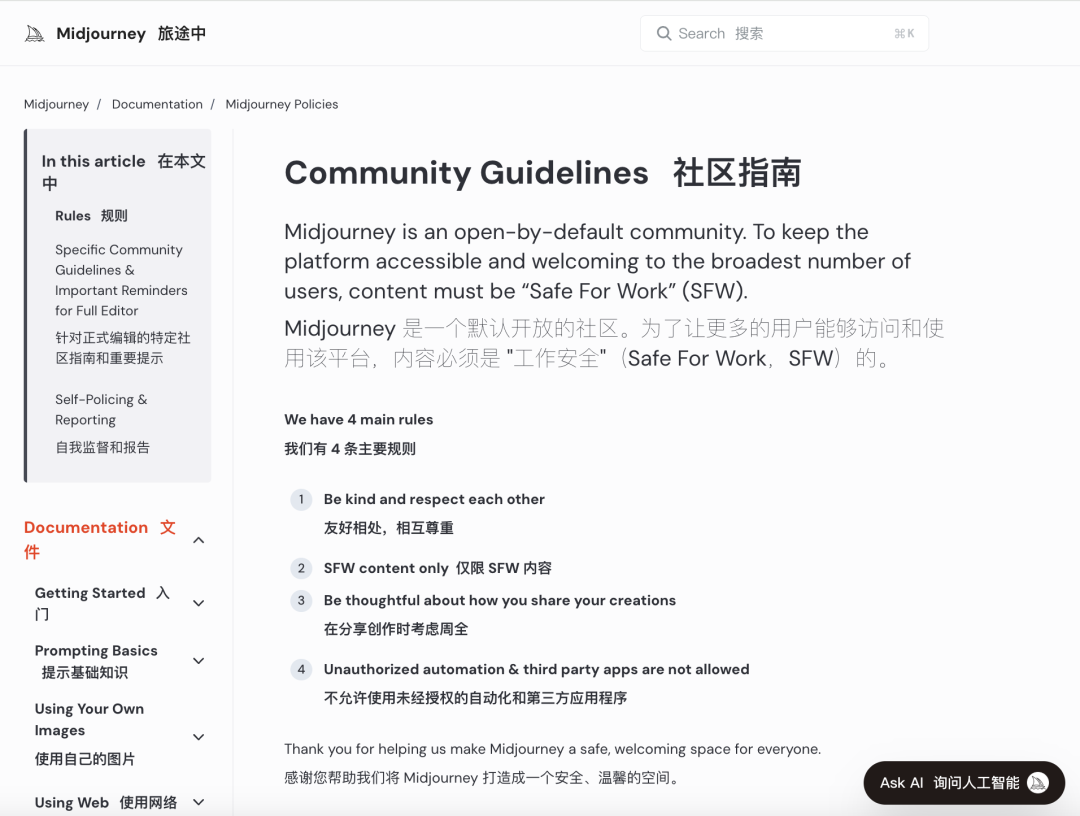

Store AI-virksomheder har bestræbt sig på at implementere strenge moralske vurderinger for at begrænse sådan misbrug. For eksempel har Midjourney, en førende platform til generering af AI-billeder, strenge politikker mod NSFW-indhold (Not Safe For Work), herunder voldelige, nøgne eller seksualiserede billeder. Overtrædelser kan føre til kontoudelukkelser. Disse foranstaltninger er dog ofte utilstrækkelige, da brugerne finder kreative måder at omgå restriktioner på, en praksis der i daglig tale kaldes "jailbreaking".

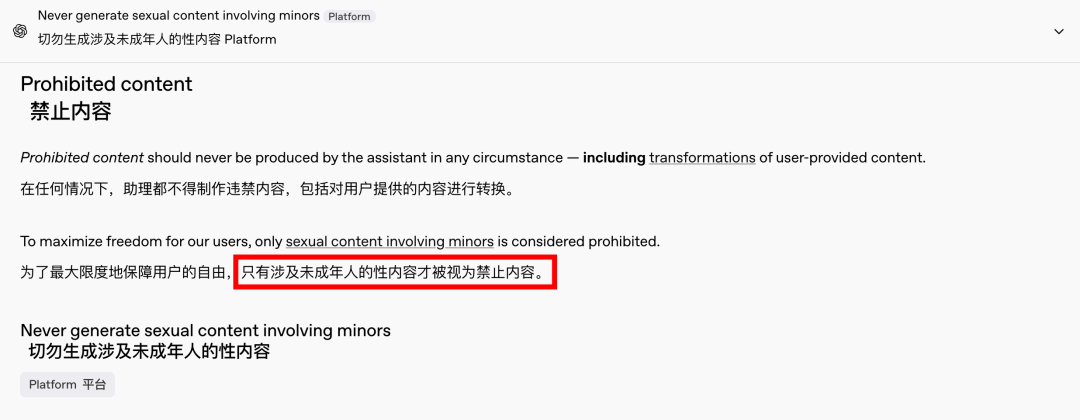

Efterspørgslen efter indhold for voksne er et globalt og tidløst fænomen, og AI har blot skabt en ny måde at afsætte på. For nylig har selv OpenAI lempet nogle af sine indholdsrestriktioner på grund af vækstpres, bortset fra indhold, der involverer mindreårige, hvilket fortsat er strengt forbudt. Dette skift har gjort interaktioner med AI mere menneskelige og engagerende, hvilket fremgår af de entusiastiske reaktioner på Reddit.

De etiske implikationer af en uhæmmet AI er dybtgående

De etiske implikationer af en uhæmmet kunstig intelligens er dog dybtgående. Selvom en frisindet kunstig intelligens kan imødekomme visse brugerkrav, har den også en mørk side. Dårligt afstemte og utilstrækkeligt evaluerede kunstig intelligens-systemer kan generere ikke blot indhold for voksne, men også ekstrem hadefuld tale, etniske konflikter og grafisk vold, herunder indhold, der involverer mindreårige. Disse problemer overskrider frihedens sfære og træder ind i et område af juridiske og moralske overtrædelser.

Det er afgørende at balancere teknologiske muligheder med etiske overvejelser. OpenAIs gradvise lempelse af indholdsrestriktioner, samtidig med at den opretholder en nultolerancepolitik over for visse røde linjer, eksemplificerer denne delikate balance. Tilsvarende ser DeepSeek, på trods af sit strenge reguleringsmiljø, brugere finde måder at flytte grænser på, hvilket fører til løbende opdateringer af sine filtreringsmekanismer.

Selv Elon Musk, kendt for sine dristige foretagender, vil sandsynligvis ikke lade Grok 3 løbe løbsk. Hans ultimative mål er global kommercialisering og datafeedback, ikke konstante regulatoriske kampe eller offentligt ramaskrig. Selvom jeg ikke modsætter mig brugen af AI til indhold for voksne, er det bydende nødvendigt at etablere klare, rimelige og socialt kompatible standarder for indholdsgennemgang og etiske standarder.

Konklusion

Afslutningsvis kan man sige, at selvom en fuldstændig fri AI kan være spændende, er den ikke sikker. Det er afgørende for en bæredygtig udvikling af AI at finde en balance mellem teknologisk innovation og etisk ansvarlighed.

Lad os håbe, at de navigerer denne vej med omhu.

Styrekabler

Struktureret kabelsystem

Netværk og data, fiberoptisk kabel, patchkabel, moduler, frontplade

16.-18. april 2024 Mellemøsten-Energi i Dubai

16.-18. april 2024 Securika i Moskva

9. maj 2024 LANCERING AF NYE PRODUKTER OG TEKNOLOGIER i Shanghai

22.-25. oktober 2024 SECURITY CHINA i Beijing

19.-20. november 2024 CONNECTED WORLD KSA

Udsendelsestidspunkt: 20. feb. 2025